Synspunkt

Å forhindre en apokalypse

Det er vanskelig å anta en øvre grense for hvor avansert generell kunstig intelligens kan bli. Da er det viktig å ha et åpent sinn, skriver Seth Baum.

Seth Baum er administrerende direktør i tenketanken GCRI og tilknyttet senteret for studier av eksistensiell risiko ved Cambridge University.

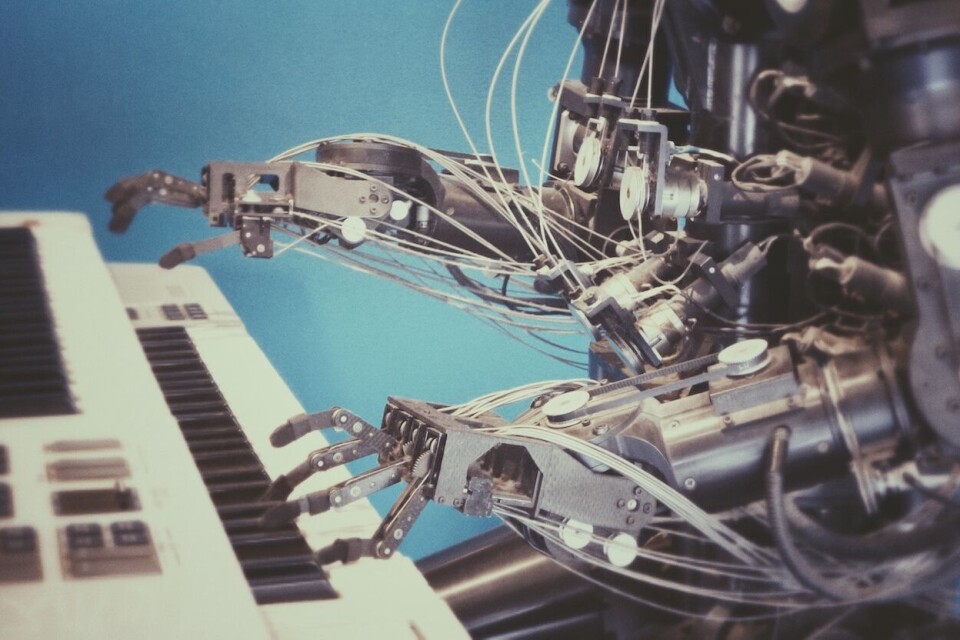

SYNSPUNKT: Utviklingen innen kunstig intelligens (AI) den seneste tiden har vært dramatisk. Kunstig intelligens er i ferd med å forandre så godt som enhver sektor i samfunnet; fra transport til medisin og forsvar. Det er derfor ingen tvil om at det er lurt å tenke gjennom hva som vil skje når denne teknologien blir enda mer avansert enn den allerede er.

Den apokalyptiske forestillingen handler om at maskiner drevet av kunstig intelligens vil bli smartere enn menneskene, ta over verden og drepe oss alle. Dette scenarioet dukker ofte opp i Science fiction, og det er rimelig enkelt å avfeie det, gitt at menneskeheten beholder en stødig kontroll. Men flere eksperter på kunstig intelligens tar det apokalyptiske perspektivet på fullt alvor, og det gjør de rett i. Det burde resten av samfunnet også gjøre.

For å forstå hva som står på spill, er det nødvendig å forstå forskjellen mellom «begrenset kunstig intelligens» og «generell kunstig intelligens». Begrenset kunstig intelligens kan kun operere innen ett eller få domener samtidig, så selv om den kan utklasse mennesker når det gjelder utvalgte oppgaver, forblir den under menneskenes kontroll.

Generell kunstig intelligens, derimot, kan operere innen en rekke domener. Dermed kan den kopiere flere menneskelige, intellektuelle evner og samtidig bevare alle teknologiske fordeler, som perfekt hukommelse. Generell kunstig intelligens kan på den måten overstige menneskelig kognisjon gjennom sin sofistikerte programvare. Det er faktisk vanskelig å anta en øvre grense for hvor avansert generell kunstig intelligens kan bli.

Åpent sinn

Nå tilhører hovedvekten av kunstig intelligens den begrensede kategorien. Til og med de mest avanserte systemene for generell kunstig intelligens kan kun operere innen visse rammer. AlphaZero-system til Google DeepMind mestret spillene sjakk, Go og Shogi – noe som gjorde systemet mer generelt enn de fleste andre systemer for kunstig intelligens, som kun kan brukes til én enkelt, spesifikk aktivitet. Systemet har likevel vist seg å bare fungere innen de avmålte rammene til noen få høyt strukturerte brettspill.

Flere kunnskapsrike personer avfeier framtidsutsiktene til avansert kunstig intelligens. Enkelte, deriblant Selmer Bringsjord ved Rensselaer Polytekniske Institutt og Drew McDermott ved Yale Universitet, påstår at det er umulig for kunstig intelligens å overgå menneskelig intelligens. Andre, blant annet Margaret A. Boden ved universitetet i Sussex og Oren Etzioni ved Allen institutt for kunstig intelligens, hevder at kunstig intelligens kan nå et menneskelig nivå i fjern fremtid, men at det er alt for tidlig å bekymre seg for det.

Disse skeptikerne er langt ifra ubetydelige personer, slik man ofte kan avfeie flere kunnskapsløse klimakseptikere for å være. De er anerkjente forskere innen datateknologi og relaterte fagfelt, og deres meninger må tas på alvor.

Andre anerkjente forskere er imidlertid bekymret for at generell kunstig intelligens kan utgjøre en alvorlig, kanskje også eksistensiell, trussel mot menneskeheten. Blant disse finner vi David J. Chalmers ved New York-universitet, Allan Dafoe ved Yale, Nick Bostrom ved Oxford, Roman Yampolskiy ved universitetet i Louisville og Stuart Russel ved Universitetet Berkeley i California. Med eksperter på begge sider av debatten, burde resten av oss ha et åpent sinn.

Sammenligning

Generell kunstig intelligens har også blitt sentralt for viktig forskning og utvikling. I en undersøkelse jeg nylig utførte, om forsknings- og utviklingsprosjekter knyttet til generell kunstig intelligens, fant jeg 45 prosjekter fordelt på 30 land og seks kontinenter. Flere av disse er forankret i store selskaper som Baidu, Facebook, Google, Microsoft og Tencent, og ved topp-universiteter som Carnegie Mellon, Harvard, Stanford og Det kinesiske vitenskapsakademiet. Det ville vært uklokt å anta at ingen av disse prosjektene vil lykkes.

Generell kunstig intelligens kan overstige menneskelig kognisjon gjennom sin sofistikerte programvare

Man kan også vurdere den potensielle trusselen forbundet med generell kunstig intelligens ved å sammenligne risikoen med andre katastrofale risikoer. På 1990-tallet tillot for eksempel dem amerikanske kongressen at NASA sporet store asteroider som kunne kollidere med jorden, selv om sjansen for at noe slikt skjer er omtrent 1 til 5000 - per århundre. Når det gjelder generell kunstig intelligens, kan oddsen for at en katastrofe inntreffer i løpet av det nærmeste århundret være så høy som en til hundre, eller kanskje en til ti. Anslagene er basert på tempoet til forsknings- og utviklingsprosjektene og graden av bekymring hos ekspertene.

Ansvar

Spørsmålet blir da hva vi kan gjøre med dette. Til å begynne med må vi forsikre oss om at forsknings- og utviklingsprosjekter utføres ansvarlig, trygt og etisk. Det krever bedre kommunikasjon mellom de som jobber innen kunstig intelligens på den ene siden og beslutningstakere, samfunnsforskere og bekymrede borgere på den andre siden. De som jobber innad i bransjen kjenner teknologien godt, og vil ha ansvar for å designe den i henhold til avtalte standarder. Men de må ikke få lov til å være alene om å bestemme hva de standardene skal være. Blant de som arbeider med å utvikle applikasjoner for kunstig intelligens, er de færreste vant til å tenke på de sosiale implikasjonene det medfører. For at det skal endre seg, må de utsettes for perspektiver utenfra.

Beslutningstakere blir i tillegg nødt til å hanskes med de internasjonale dimensjonene forbundet med kunstig intelligens. Akkurat nå utføres hovedvekten av forsknings- og utviklingsarbeid knyttet til generell kunstig intelligens i USA, Europa og Kina. Men store deler av kodematerialet ligger åpent, noe som betyr at arbeidet i teorien kan utføres hvor som helst. Etableringen av felles standarder og etiske grunnregler er derfor, til syvende og sist, en jobb for hele det internasjonale samfunnet, selv om forsknings- og utviklingsprosjektene burde lede an i dette arbeidet.

Risikominimering

I fremtiden kan noen forsøk på å håndtere risikoen knyttet til generell kunstig intelligens bygge videre på politiske initiativer som allerede er iverksatt i sammenheng med den begrensede kunstige intelligensen, som for eksempel kongressens nye uavhengige AI-gruppe, lansert av demokratenes kongressmann John Delaney fra Maryland. Mange synergieffekter kan oppstå mellom de som jobber med kortsiktig risiko knyttet til kunstig intelligens og de som tenker på de langsiktige virkningene.

Men uavhengig av hvorvidt begrenset kunstig intelligens og generell kunstig intelligens ses på samlet eller hver for seg, er det aller viktigst at vi handler konstruktivt med tanke på å minimere risikoen for at det oppstår en katastrofe lenger framme i løypa. For dét er en utfordring vi ikke kan regne med at vi klarer å håndtere i siste liten.

Oversatt fra engelsk av Ingrid Lerø.

Copyright: Project Syndicate, 2018. www.project-syndicate.org